本地知识库-ragflow

# 前提条件

# 系统配置

- CPU >= 4 cores

- RAM >= 16 GB

- Disk >= 50 GB

# 环境

Docker >= 24.0.0 & Docker Compose >= v2.26.1

If you have not installed Docker on your local machine (Windows, Mac, or Linux), see Install Docker Engine (opens new window).

ollama

如果使用cpu运行,请使用v0.3.13 (opens new window) ,务必先卸载高版本的ollama。高版本如使用cpu运行会报错GGML_ASSERT(i01 >= 0 && i01 < ne01) failed issue (opens new window) ,如未卸载新版本会报错Error LLama runner process has terminated issue (opens new window)

# 安装Ragflow

可根据项目安装文档进行安装 ragflow-github (opens new window) ,不同版本可能安装步骤不同,已项目README为准

具体如下:

linux环境需配置

Ensure

vm.max_map_count>= 262144:To check the value of

vm.max_map_count:$ sysctl vm.max_map_count1Reset

vm.max_map_countto a value at least 262144 if it is not.# In this case, we set it to 262144: $ sudo sysctl -w vm.max_map_count=2621441

2This change will be reset after a system reboot. To ensure your change remains permanent, add or update the

vm.max_map_countvalue in /etc/sysctl.conf accordingly:vm.max_map_count=2621441Clone the repo:

$ git clone https://github.com/infiniflow/ragflow.git1启动

$ cd ragflow $ docker compose -f docker/docker-compose.yml up -d1

2查看启动日志

docker logs -f ragflow-server1访问

默认运行在80端口,

http://localhost:80即可访问

# 配置Ragflow

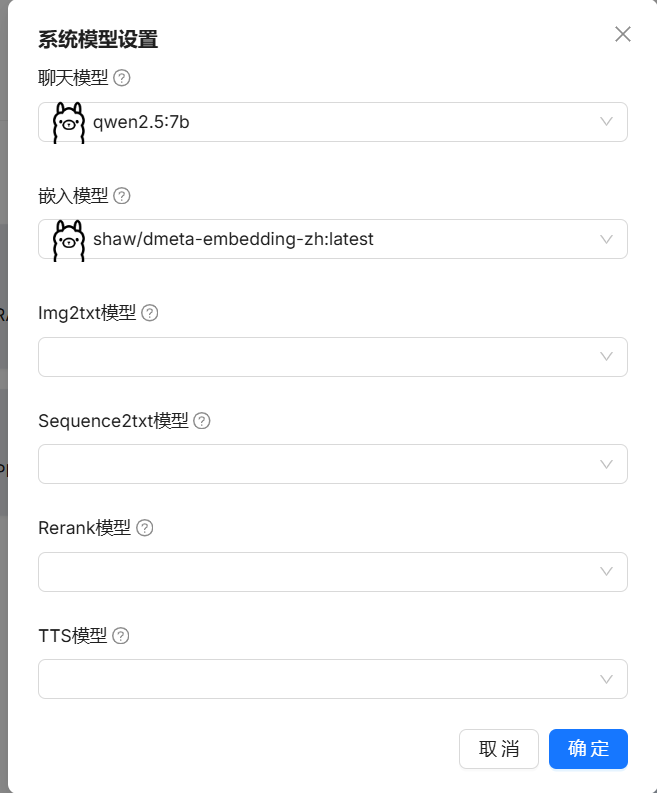

通过ollama管理模型,点击右上角头像进入设置,选择模型提供商,在【待添加的模型】中找到ollama

- 添加qwen2.5:7b模型

- 模型名称建议通过

ollama list查看模型并复制模型名称 - 类型则根据实际模型类型配置

- 基础URL则为ollama的url,默认url为

127.0.0.1:11434,可将ollama改为监听0.0.0.0来获取本机网卡ip填入,否则不通。 - API Key是给一些付费的模型服务商准备的,本地模型不需要

- 最大tokens数根据需求填写

- 是否支持vision,多模态模型需要,其他不需要开启

- 模型名称建议通过

- 添加embedding模型,推荐shaw/dmeta-embedding-zh:latest

- ollama中安装此模型,在

ollama.com搜索此模型找到其安装命令,命令行安装即可 - 如上在RAGFlow中的ollama中添加embedding模型

- ollama中安装此模型,在

- 点击【系统模型配置】

# 新建知识库

点击知识库,新建知识库,点击进入刚创建的知识库,完成以下配置

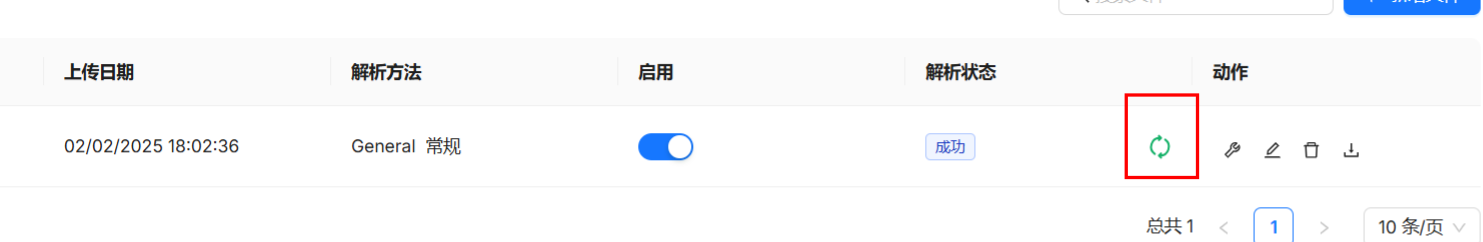

- 点击【配置】,语言根据自己知识库语料类型选择。解析方法可根据每个方法适用的类型自行选择

解析数据

【数据集】,解析数据

# 聊天

- 新建助理,点击左上角新建助理

- 助理设置,选择知识库,其他按需填写。

- 模型设置